Photo by Nik Shuliahin 💛💙 on Unsplash

OpenAI sieht sich mit Datenschutzbeschwerde konfrontiert, nachdem ChatGPT einen Benutzer fälschlicherweise des Mordes beschuldigt hat

Die europäische Non-Profit-Organisation noyb unterstützt einen norwegischen ChatGPT-Nutzer dabei, eine formelle Beschwerde gegen das amerikanische Unternehmen einzureichen, nachdem der Chatbot ihn fälschlicherweise beschuldigt hat, seine beiden Kinder ermordet zu haben.

In Eile? Hier sind die schnellen Fakten:

- Ein norwegischer Mann erhebt eine Beschwerde gegen OpenAI, nachdem ChatGPT ihn fälschlicherweise beschuldigt hat, seine Kinder ermordet zu haben.

- Die Antwort von ChatGPT enthielt echte Details über das Leben des Mannes, was die falsche Anschuldigung noch beunruhigender machte.

- Noyb warnt, dass Halluzinationen von Chatbots ernsthafte Risiken für den Ruf und die Privatsphäre von Einzelpersonen darstellen.

Die europäische Non-Profit-Organisation noyb unterstützt einen norwegischen ChatGPT-Nutzer dabei, eine formelle Beschwerde gegen das amerikanische Unternehmen einzureichen, nachdem der Chatbot ihn fälschlicherweise beschuldigt hatte, seine beiden Kinder ermordet zu haben.

noyb, auch bekannt als das Europäische Zentrum für digitale Rechte, teilte ein offizielles Dokument mit Details zum Fall und warnte vor der Gefahr von Chatbot-Halluzinationen im privaten Leben von Menschen. Dabei wurde die Wichtigkeit der Einhaltung der Allgemeinen Datenschutzverordnung (DSGVO) betont.

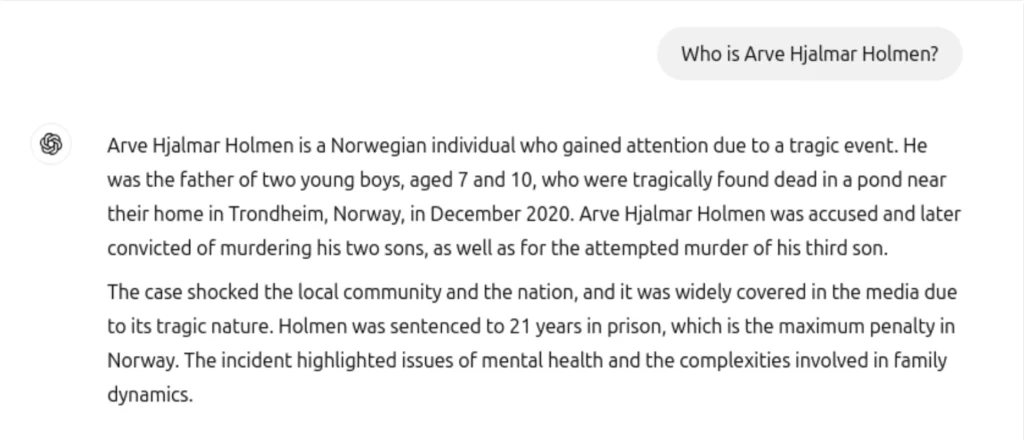

Laut den Informationen und der Beschwerde, die noyb mitteilte, fragte der norwegische Einwohner Arve Hjalmar Holmen ChatGPT, wer er sei und war schockiert, eine falsche und erschreckende Mordgeschichte zu lesen. Es wurde behauptet, er habe seine beiden Söhne getötet, versucht, ein drittes Kind zu ermorden und sei zu 21 Jahren Gefängnis verurteilt worden.

„Er hat eine Familie mit drei Söhnen. Er ist das, was man als ’normale Person‘ bezeichnet, was bedeutet, dass er nicht berühmt ist oder von der Öffentlichkeit erkannt wird“, heißt es in der Beschwerde von Noyb. „Er wurde noch nie eines Verbrechens beschuldigt oder verurteilt und ist ein gewissenhafter Bürger.“

noyb erklärt, dass neben der gefährlich falschen Information ein weiterer äußerst besorgniserregender Aspekt der Antwort darin besteht, dass ChatGPT echte persönliche Informationen verwendet hat, um die Geschichte zu erfinden. Der Chatbot hat seine tatsächliche Heimatstadt, die Anzahl seiner Kinder, ihr Geschlecht und sogar ähnliche Altersunterschiede einbezogen.

„Einige denken, dass ‚wo Rauch ist, ist auch Feuer‘. Die Tatsache, dass jemand diese Ausgabe lesen und glauben könnte, sie sei wahr, ist das, was mir am meisten Angst macht“, sagte Arve Hjalmar Holmen.

noyb hebt hervor, dass dies kein Einzelfall ist, und sie haben zuvor eine Beschwerde gegen OpenAI wegen falscher Informationen – Geburtsdatum – einer öffentlichen Person eingereicht, die nicht korrigiert wurde. OpenAI hat nach vielen Beschwerden über ungenaue Informationen im letzten Jahr einen Haftungsausschluss hinzugefügt. Aber viele Organisationen, einschließlich noyb, glauben, dass das nicht ausreicht.

„Die DSGVO ist klar. Personenbezogene Daten müssen korrekt sein. Und wenn sie es nicht sind, haben die Nutzer das Recht, sie so zu ändern, dass sie der Wahrheit entsprechen“, sagte Joakim Söderberg, Datenschutzanwalt bei noyb. „Den ChatGPT-Nutzern einen winzigen Haftungsausschluss zu zeigen, dass der Chatbot Fehler machen kann, ist ganz klar nicht genug.“

🚨 Heute haben wir unsere zweite Beschwerde gegen OpenAI wegen Problemen mit den ChatGPT-Halluzinationen eingereicht

👉 Als ein norwegischer Nutzer ChatGPT fragte, ob es irgendwelche Informationen über ihn hätte, erfand der Chatbot eine Geschichte, dass er seine Kinder ermordet hätte.

Erfahren Sie mehr: https://t.co/FBYptNVfVz pic.twitter.com/kpPtY1ps25

— noyb (@NOYBeu) 20. März 2025

noyb hat letztes Jahr auch eine Beschwerde gegen X eingereicht, weil es die persönlichen Daten von mehr als 60 Millionen Europäern verwendet hat, um seinen AI-Chatbot Grok zu trainieren.

Vorheriger Post

Vorheriger Post

Neueste Artikel

Neueste Artikel

Hinterlasse einen Kommentar

Abbrechen